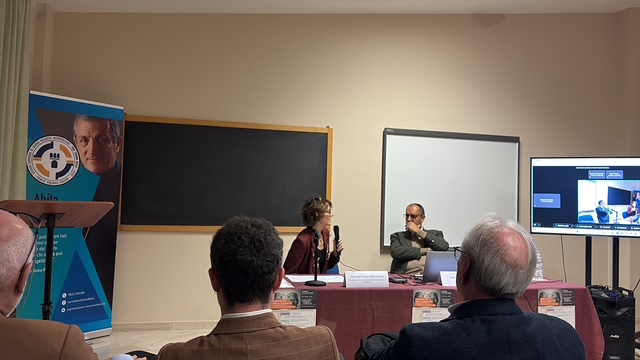

Lecce accoglie la primavera con un momento di riflessione e confronto: venerdì 20 marzo 2026, presso l’ISSR metropolitano “Don Tonino Bello”, si è svolto il convegno “Comunicare per la comunità:in dialogo con l’intelligenza artificiale”. L’iniziativa ha richiamato una platea numerosa e attenta, che ha seguito gli interventi in un clima di ascolto partecipe e rispettoso silenzio.

Cambiano le coordinate dell’equinozio della stagione e allo stesso tempo cambiano le coordinate della comunicazione. Relazioni e partecipazioni accese dal vivo e da collegamento di luminari e studiosi di tutte le branche dello scibile umano (teologia, psicologia, filosofia, biologia, giurisprudenza, neuroscienze) tra giornalisti freelance e docenti di epistemologia e della comunicazione, si sono alternate e succedute in modo armonioso ed accattivante. Infatti, argomenti su cosa sia l’Intelligenza Artificiale e come possiamo utilizzarla hanno svegliato interesse ed attenzione non solo agli studenti di scienze religiose interni all’Istituto presenti in maggioranza, ma anche di tutti gli altri invitati esterni professionisti e no. Già dai saluti istituzionali si è notato un incipit di riflessioni partecipate in una visione olistica su temi all’ordine del giorno.

Il giovane direttore dell’ISSRM, prof. Antonio Bergamo, commosso ed entusiasta ha sottolineato che l’espressione “in dialogo” è già un modo per interpretare la realtà auspicando ad un approccio dialogico che caratterizza un modus agendi dell’antropologia relazionale. Chiara Maggiore, docente dell’ISSRM di Teorie e tecniche della comunicazione, ha moderato con garbo e gentilezza, affiancando i relatori abbracciando in sé psicologia e scienze umane il background formativo personale.

Gianpasquale Preite direttore CREV Università del Salento ha sottolineato ed auspicato, con le 15 unità di ricerca attive, un cambio di paradigma con un rapporto soggetto-oggetto dialogico sia sul fronte psicologico che su quello giuridico.

Una presenza importante e provocatoria quella del dott. Giuseppe Vinci, Presidente dell’Ordine delle Psicologhe e degli Psicologi di Puglia che ha lanciato spunti di riflessione che toccano le corde della coscienza, dell’anima e del cuore. «La IA – afferma Vinci – si muove verso nuovi sviluppi e riprogramma ed espande se stessa, ma l’inquietudine è d’uopo. Dobbiamo essere inquieti! In ambito psicologico la IA pone rischi alti poiché si basa su un trucco, simula una persona; ci si trova a dialogare con una IA che ha voce, toni, argomenti a noi confacenti. L’intelligenza artificiale è compiacente! Sul piano clinico pratico e deontologico il Presidente PSI sottolinea che la IA può essere utile per sostituire tecniche e attività come, ad esempio, lettura di manuali di auto-aiuto, ma «incrociare persone con fragilità, ad esempio -un disturbo fobico nell’elaborazione del lutto, porterà alla necessità di liberarsi da relazioni ‘fasulle’ nelle quali si sono incagliate. Siamo in una costante accelerazione dei ritmi di vita, l’IA incrementerà ancora: ma se già adesso siamo alienati. Hartmut Rosa parla di ‘stasi iper-accelerata, di frenesia immobile’. È un grosso rischio dunque rimanere affascinati dall’intelligenza artificiale senza responsabilità, coscienza ed assetto etico».

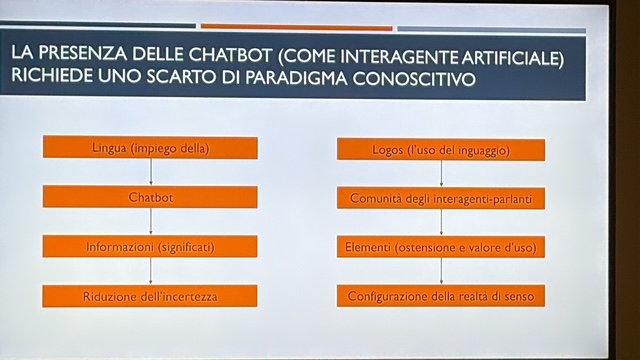

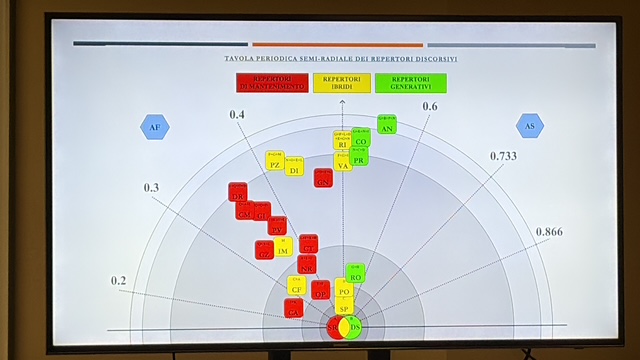

Paolo Baldi, docente di logica dell’informazione presso l’Università del Salento, ha illustrato come IA e filosofia siano intrecciati ed ha ricordato come sia necessario mantenere equità nel processo di decisione e nell’impatto decisionale. Spesso infatti sussisterebbero problemi di natura etica poiché le ricerche artificiali non sono filtrate da scelte e feedback di natura morale, da valori costituzionali. Baldi ha menzionato esempi e rischi della IA in ambito mondiale, emblematico il caso COMPAS (Correctional Offender Management Profiling for Alternative Sanctions) e l’inchiesta di Propublica del 2016 organizzazione giornalistica che analizzò migliaia di punteggi in Florida, riscontrando che l’algoritmo mostrava pregiudizi razziali. Negli Stati Uniti si utilizzava il software per calcolare rischio di recidiva reati e conseguenti pene e premi da parte dei giudici, evidenziando opacità dei sistemi di IA e l’urgenza di trasparenza e di un controllo umano rigoroso per evitare che i pregiudizi storici vengano automatizzati e perpetuati. L’uso non consapevole dei sistemi IA può tradursi in lesioni dei diritti fondamentali quali riservatezza e protezione dei dai personali e compromettere il principio di uguaglianza, ha sostenuto e ribadito Alessandro Sbarro, docente di diritto penale all’Università del Salento. Sul piano collettivo fake news e altri contenuti generati artificialmente creano attacchi sistematici per il giurista, rendendo indistinguibile l’argomentazione reale umana da quella algoritmica manipolando così il dibattito pubblico interferendo nei processi democratici e impedendo un’informazione veritiera, libera e plurale. Sbarro propone un controllo costituzionale degli agenti artificiali fondata su sistemi cristallini basati su principi supremi (dignità umana, uguaglianza sostanziale, solidarietà sociale, democrazia partecipativa) e sulle più recenti acquisizioni della Constitutional AI e dell’AI alignment, ossia allineamento ed equità sulla base dei valori costituzionali e morali. Da qui l’importanza di una gestione degli algoritmi e di un giusto contradditorio soprattutto in ambito medico e psicologico che sa di contenimento non solo culturale ma soprattutto deontologico, scientifico e morale. Il prof Gian Piero Turchidocente di Psicologia presso l’Università di Padova ha esortato la platea a gran voce «Abbiamo sbagliato a chiamarla Intelligenza artificiale! è solo artificiale! »,forte degli studi attuali di ricerca veneti dove non solo protocolli d’avanguardia ma anche fino a 24 regole fondamentali dialogiche del linguaggio che generano configurazioni di senso e comunicazione sono stati generati, compresi e elaborati. IA e Chatbot che, come interagenti artificiali, richiedono uno scarto di paradigma conoscitivo (da “penso dunque sono “cogito ergo sum di Cartesio, a “si dice dunque penso “dicitur ergo cogito; da Logos de rerum natura a Logos de natura rerum di Lucrezio) non generano nuove configurazioni di realtà di senso: essi non possono creare. Ecco il grande limite assoluto degli algoritmi artificiali che non solo non sanno fare da filtro ma che non riconoscono ‘allucinazioni’ reali da quelle artificiali. L’interlocutrice sempre disponibile, efficiente, adattabile, dotata di un sapere all’apparenza illimitato capace di gestire richieste complesse ‘come se’ comprendesse, la IA di fatto non può gestire la configurazione di senso nell’uso del linguaggio. E tutto parte dal linguaggio, dal Logos. Ha fatto seguito un’esercitazione pratica sul dilemma se interagire o dialogare con le macchine, che hanno difficoltà nella pragmatica di comprensione di senso del linguaggio. Dopo queste dissertazioni di neuroscienze e sull’importanza di usare con scienza e coscienza la IA, come qualunque strumento che può essere utile all’essere umano se usato con ‘intelligenza reale’ e cautela, dulcis in fundo la presentazione da parte di Marco Renna del volume Comunicare (per) la comunità. Percorsi di coesione e narrazione collettiva, edizione Vivere In. Il moderatore giornalista assieme a Chiara Maggiore che ha curato il volume, risultato della prima edizione del convegno, ha fatto alcune riflessioni sulla responsabilità narrativa come competenza di discernimento di comunicazione. E sulla comunicazione bisogna sempre avere chiari gli obiettivi da raggiungere.